Deepfake: as consequências de se imitar a vida real

28 de outubro de 2022, 13h02

Aristóteles, há uns bons séculos atrás, já havia identificado que "a arte imita a vida". Posteriormente, na era moderna, Oscar Wilde observou que a situação contrária também é uma verdade, postulando que "a vida imita a arte". Contemporaneamente, o consumo das sete artes nos confirma, dia após dia, a sapiência destes dois pensadores.

No Brasil uma das principais expressões artísticas são as novelas, onde não foram raras as vezes em que nos deparamos com questões sociais de nosso cotidiano retratadas nestas obras brasileiras.

Neste mês de outubro de 2022, a consagrada escritora Gloria Perez colocou em pauta os crimes cibernéticos e suas consequências na sua nova novela A Travessia. Semelhante ao que ocorreu com Fabiane Maria de Jesus em 2014 [1], a atual trama de Gloria Perez retrata o drama vivido por uma mulher que teve seu rosto utilizado, indevidamente, em um vídeo a acusando de sequestrar crianças [2], o que gerou a necessidade de fugir de sua cidade para não ser linchada até a morte — como assim tragicamente ocorreu com Fabiane de Jesus.

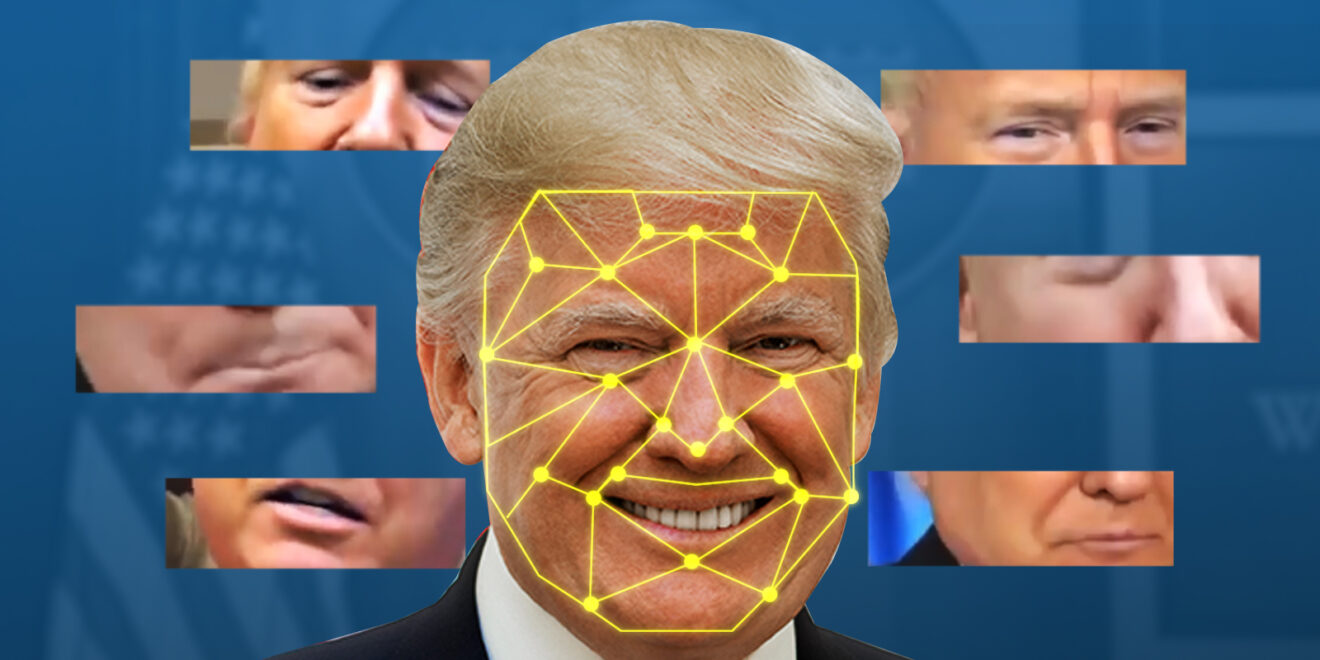

O uso da imagem de terceiros em um vídeo, como nestes dois casos, é conhecido como deepfake, onde a verdade é distorcida para propagar a desinformação através do uso da imagem e/ou voz de pessoas que não necessariamente estavam no vídeo original.

Este novo fenômeno é uma técnica desenvolvida com o uso de inteligência artificial, sendo a nomenclatura deepfake originada pela junção das expressões em língua inglesa "deep", que significa "profundo" e faz referência ao deep learning — um tipo de machine learning no qual a inteligência artificial busca reproduzir a inteligência humana —; e "fake", cuja tradução para o português é de "falso", em alusão à propagação de fake news ("notícias falsas").

Segundo Momina Masood, traduzida por Magaly Parreira do Prado [3], os deepfakes:

"podem ser categorizados nos seguintes tipos:

1) troca de rosto;

2) dublagem;

3) fantoche-mestre;

4) rosto síntese e manipulação de atributos;

5) deepfakes de áudio" [4] (página 56).

Os primeiros casos conhecidos de deepfake ocorreram em 1990, mas passaram a ganhar fama e recorrência em 2017 através do uso do rosto de celebridades em cenas de pornografia, as quais jamais haviam sido filmadas por elas [5]. No ano seguinte, o diretor de cinema Jordan Peele se uniu ao Buzzfeed News para criar um deepfake do presidente Barack Obama [6], com o propósito de conscientizar a sociedade sobre o aumento da circulação de informações falsas.

Infelizmente o deepfake não é utilizado apenas para o bem, como pretendido por Peele. Recentemente, no Brasil, a voz e a imagem da jornalista Renata Vasconcellos foram usadas em um deepfake para a divulgação de resultado inverídico de pesquisa de intenção de votos para eleição de presidente [7].

Este não foi o único caso de deepfake durante as eleições para a principal cadeira do Poder Executivo de 2022. O ex-presidente Lula foi alvo de um deepfake onde estaria reclamando sobre a embalagem de paçocas com menos produtos do que o esperado pelo consumidor [8] [9]. Já seu concorrente neste segundo turno das eleições, o atual presidente Bolsonaro, foi alvo de um deepfake em que confirma, caso eleito, a nomeação do ex-presidente Fernando Collor para o Ministério do Trabalho e Previdência, além do confisco da aposentadoria da população brasileira [10].

Apesar de o Direito se atualizar às mudanças de nossa sociedade, comumente o Legislador não consegue acompanhar a rapidez das alterações sociais para adequar o ordenamento jurídico — seja através da implementação, vedação ou extinção de textos legais. Todavia, dada a importância e sensibilidade do assunto, em 2020, o deputado federal Eduardo Bismarck (PDT-CE) apresentou o Projeto de Lei 21/2020 com o fito de estabelecer "fundamentos, princípios e diretrizes para o desenvolvimento e a aplicação da inteligência artificial no Brasil", já tendo sido aprovado pelo plenário em 2021.

O texto original do deputado federal Eduardo Bismarck não prevê a responsabilidade sobre os fatos jurídicos — como a violação de direitos de personalidade [11] [12] — através da inteligência artificial, como tampouco pena e/ou dever indenizatório aos lesados.

No mesmo ano de 2020, o senador Alessandro Vieira (Cidadania/SE) apresentou o Projeto de Lei 2630/2020 (Lei das Fake News) para o "combate à desinformação e pelo aumento da transparência na internet, à transparência em relação a conteúdos patrocinados e à atuação do poder público, bem como estabelece sanções para o descumprimento da lei", havendo em seu artigo 5, §3º a vedação ao deepfake, sem, contudo, prever a responsabilização cível ou criminal dos responsáveis:

"Artigo 5º São vedados, nas aplicações de internet de que trata esta Lei: (…)

§3º Dada a natureza complexa e em rápida mudança do comportamento inautêntico, os provedores de aplicação devem desenvolver procedimentos para melhorar as proteções da sociedade contra comportamentos ilícitos, incluindo a proteção contra o uso de imagens manipuladas para imitar a realidade, observado o disposto no §1º deste artigo."

Em razão de os dois projetos de lei acima ainda não terem sido sancionados — tendo este último também sido aprovado em plenário e atualmente aguardando a aprovação pela Câmara dos Deputados — os casos de deepfake devem ser analisados com base em suas peculiaridades para aplicação dos dispositivos ora vigentes em nosso ordenamento jurídico. Com base nos exemplos acima mencionados, podem ser aplicadas a Lei Carolina Dieckmann (Lei nº 12.737/2012) e a Lei nº 13.718/2018 para as hipóteses de deepfake pornográfico; o Código Eleitoral (Lei nº 4.737/1965) para as situações envolvendo conteúdo político durante as eleições do Poder Executivo; e o Código Penal para os deepfakes caluniosos, difamatórios ou injuriosos [13], especialmente este primeiro tipo penal para o caso retratado na obra de Gloria Perez A Travessia, havendo, inclusive, previsão ao artigo 141, §2º do Código Penal para a condenação do responsável por tais atos no triplo da pena base quando "crime é cometido ou divulgado em quaisquer modalidades das redes sociais da rede mundial de computadores".

Não apenas, de maneira geral, os casos de deepfake podem ser processados com amparo na Lei de Crimes Cibernéticos (Lei nº 12.737/2012), no Marco Civil da Internet (Lei nº 12.965/2014 — "MCI") e na Lei Geral de Proteção de Dados Pessoais (Lei nº 13.709/2018), textos que disciplinam a preservação dos direitos de personalidade, o procedimento para identificação dos infratores e o apenamento destes, seja no âmbito cível ou criminal.

Na esfera cível, é possível a propositura de ação de obtenção de dados pautada nos artig os 7, 10, 13, 15, 21 e 22 do MCI, com o objetivo de remover o conteúdo infrator e identificar os responsáveis por sua criação e circulação. Com estes dados, a parte que teve sua personalidade violada poderá requerer a indenização pelos danos morais e materiais decorrentes destes atos, conforme disciplinado aos artigos 5, X da CF; 7, I do MCI; 42, §1º da LGPD; e 186 e 927 do Código Civil ("CC").

Além de o responsável pelo deepfake indenizar a parte lesada, poderá incorrer na pena de detenção de seis meses a um ano, mais multa, por "incluir pessoa em cena de nudez ou ato sexual ou libidinoso de caráter íntimo", como previsto ao artigo 216-B do CP.

Considerando o aumento exponencial da propagação de fake news, golpes aplicados na internet [14] [15] e, agora, do deepfake, mostra-se essencial o benefício da dúvida ao acessar informações disponibilizadas na internet e sempre consultar fontes de informação confiáveis, como exemplo das grandes mídias de comunicação, pois estas possuem "editôres [sic], diretores ou redatores conhecidos" (artigo 1, §1º da Lei da Liberdade de Imprensa — Lei nº 2.083/1953).

Ademais, para mitigar o incremento da deepfake, é importante reforçar a proteção de seus dados pessoais, evitando a divulgação de sua imagem e voz com terceiros estranhos ao seu convívio social offline, podendo ser adotadas as seguintes medidas de segurança:

— Utilizar a autenticação de dois fatores em seus aplicativos de redes sociais;

— Evitar a participação em grupos de redes sociais e de troca de mensagens com pessoas que não conheça, pois podem existir pessoas má intencionadas que participam apenas para extrair dados de terceiros;

— Caso não seja uma pessoa pública (como exemplo de artistas e políticos), evitar a exposição de sua imagem em redes sociais, mantendo seu perfil bloqueado/privado para acesso de terceiros estranhos ao seu convívio offline;

No caso de empresas, é indispensável a adoção de medidas tecnológicas de segurança digital, bem como a criação de sólida estratégia jurídica para repressão dos casos de deepfake que venham a sofrer, capazes, em sua maioria, de macular a imagem da companhia no mercado.

Apesar de a inteligência artificial e as demais tecnologias imitarem a vida real, não se pode esquecer que todos os atos praticados no mundo digital impactam na vida offline, devendo seus usuários ser responsabilizados pelos atos, fatos e crimes ali cometidos.

[1] Disponível em: https://www.jota.info/coberturas-especiais/liberdade-de-expressao/facebook-nao-indenizara-familia-de-mulher-linchada-apos-boatos-virtuais-decide-tjsp-17092020. Acesso em: 16.10.2022.

[2] O que pode ser tipificado como crime de sequestro ao artigo 148, §1º, I do Código Penal ("CP").

[3] Pesquisadora de pós-doutorado na Cátedra Oscar Sala, do Instituto de Estudos Avançados, da Universidade de São Paulo e na Escola de Comunicações e Artes (ECA). Doutora em Comunicação e Semiótica e mestra em Tecnologias da Inteligência e Design Digital, ambos pela Pontifícia Universidade Católica São Paulo (PUC-SP).

[4] PRADO, Magaly Parreira do. Deepfake de áudio: manipulação simula voz real para retratar alguém dizendo algo que não disse. TECCOGS — Revista Digital de Tecnologias Cognitivas, nº 23, jan./jun. 2021, p. 45-68.

[5] Disponível em: https://super.abril.com.br/tecnologia/afinal-o-que-sao-deepfakes/. Acesso em: 16.10.2022.

[6] Disponível em: https://www.youtube.com/watch?v=cQ54GDm1eL0. Acesso em: 15.10.2022.

[7] Disponível em: https://www.youtube.com/watch?v=JaQnJ9i2qPw. Acesso em: 15.10.2022.

[8] Disponível em: https://www.youtube.com/watch?v=7OPLFJCwQzQ. Acesso em: 15.10.2022.

[9] O que poderia configurar crime contra o consumidor nos termos do artigo 67 do Código de Defesa do Consumidor (Lei nº 8.078/1990): "Artigo 67. Fazer ou promover publicidade que sabe ou deveria saber ser enganosa ou abusiva: Pena Detenção de três meses a um ano e multa".

[10] Disponível em: https://www.instagram.com/p/CjsRYcguwCT/?igshid=MDJmNzVkMjY%3D. Acesso em: 15.10.2022.

[11] Nos termos do artigo 5, X da Constituição Federal ("CF"): "Artigo 5º (…) X – são invioláveis a intimidade, a vida privada, a honra e a imagem das pessoas, assegurado o direito a indenização pelo dano material ou moral decorrente de sua violação".

[12] Nos termos da Lei Geral de Proteção de Dados ("LGPD"): "Artigo 5º Para os fins desta Lei, considera-se: I – dado pessoal: informação relacionada a pessoa natural identificada ou identificável; II – dado pessoal sensível: dado pessoal sobre origem racial ou étnica, convicção religiosa, opinião política, filiação a sindicato ou a organização de caráter religioso, filosófico ou político, dado referente à saúde ou à vida sexual, dado genético ou biométrico, quando vinculado a uma pessoa natural;".

[13] Previstos aos artigos138, 139 e 140 do CP.

[14] Como exemplo de catfishing, onde perfis falsos são criados na internet, especialmente em redes sociais e de relacionamento, para aplicação de golpes financeiros, especialmente fraude nos termos do artigo 171 §2º-A do CP. Quando a situação envolver ato sexual, pode ser aplicado o artigo 215 do CP; e, havendo exploração sexual, o artigo 228, §2º do CP.

[15] Outro exemplo a ser citado é o do estupro coletivo realizado através de realidade virtual contra a britânica Nina Jane Patel, onde, apesar de não ter ocorrido o abuso físico em si, houve enorme abuso psicológico. Disponível em: https://istoe.com.br/mulher-afirma-ter-sido-vitima-de-estupro-coletivo-em-realidade-virtual/. Acesso em: 16.10.2022.

Encontrou um erro? Avise nossa equipe!